AI Agent本地化部署知识库完全指南:从技术选型到生产实践

根据Gartner最新研究报告,2025年标志着代理型AI走向主流化,预计到2028年,33%的企业级软件应用将整合AI Agent。然而,面对数据隐私合规、成本控制和技术落地等多重挑战,越来越多企业开始探索AI Agent的本地化部署方案。本文将为您提供一份从技术架构到实践部署的完整指南,帮助企业构建安全、高效、可控的本地化AI智能体知识库系统。

一、AI Agent本地化部署概述:市场趋势与核心价值

1.1 本地化部署的市场驱动力

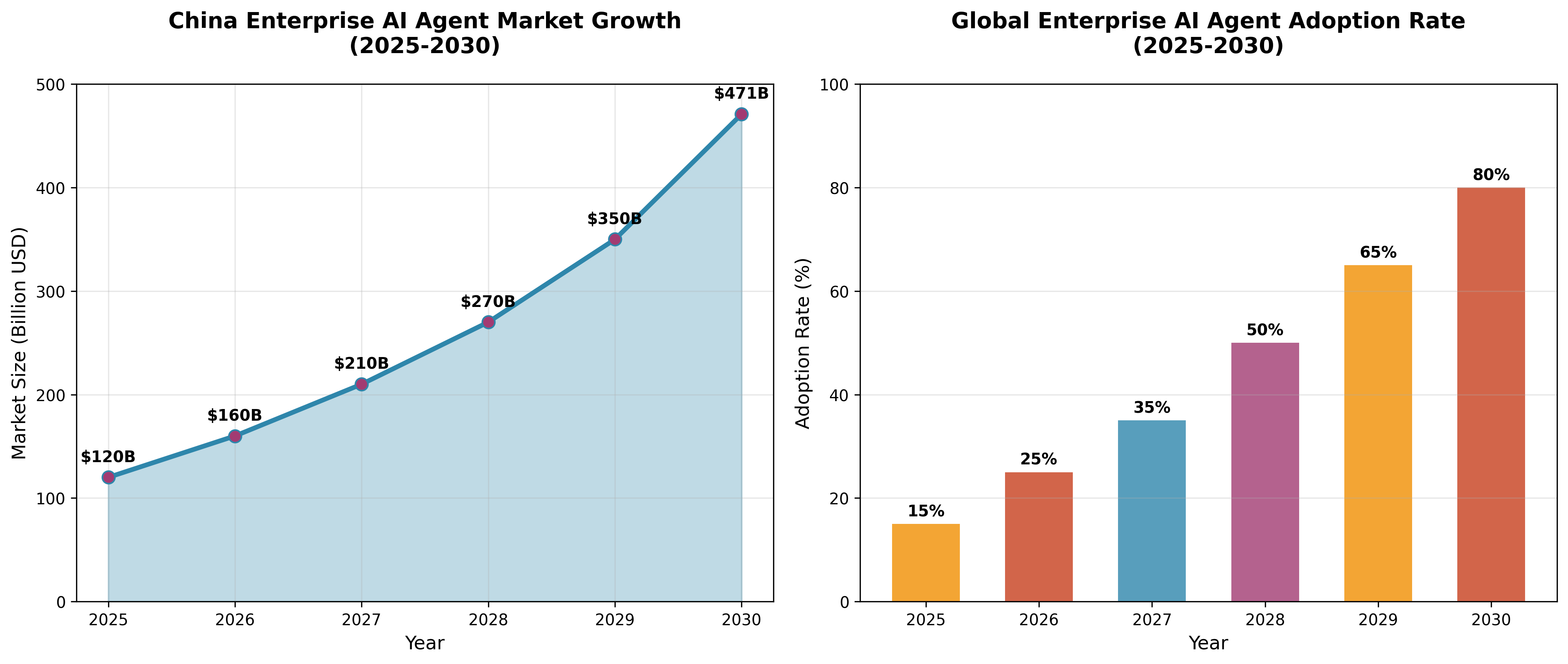

企业级AI Agent市场正经历前所未有的增长。据Markets and Markets研究报告显示,中国企业级AI Agent应用市场在2028年的保守规模将超过270亿美元,预计到2030年可增长至471亿美元。

如图:中国AI Agent市场规模增长趋势与全球企业采用率预测(2025-2030)

如图:中国AI Agent市场规模增长趋势与全球企业采用率预测(2025-2030)

这一快速增长背后,本地化部署需求呈现三大驱动力:

数据安全合规要求日益严格:金融、政务、医疗等行业对数据不出域的要求,使得本地化部署成为刚性需求。根据调研数据,超过78%的大型企业将数据安全列为AI部署的首要考虑因素。

成本控制与长期ROI优化:对于日均调用量超过100万次的企业应用,私有化部署的3年总拥有成本(TCO)比公有云部署低30-40%,这一成本优势随着规模扩大而愈发明显。

业务定制化与技术自主可控:本地化部署使企业能够根据特定业务需求进行深度定制,避免对外部服务商的技术依赖。

1.2 AI Agent与知识库集成的核心价值

现代AI Agent不再是简单的对话机器人,而是具备自主决策和任务执行能力的智能系统。当Agent与企业知识库深度集成后,能够实现:

- 精准的领域知识问答:基于企业私有数据提供专业、准确的回答

- 智能的业务流程自动化:结合知识库信息自动执行复杂业务任务

- 持续的知识积累与优化:通过交互不断丰富和优化知识体系

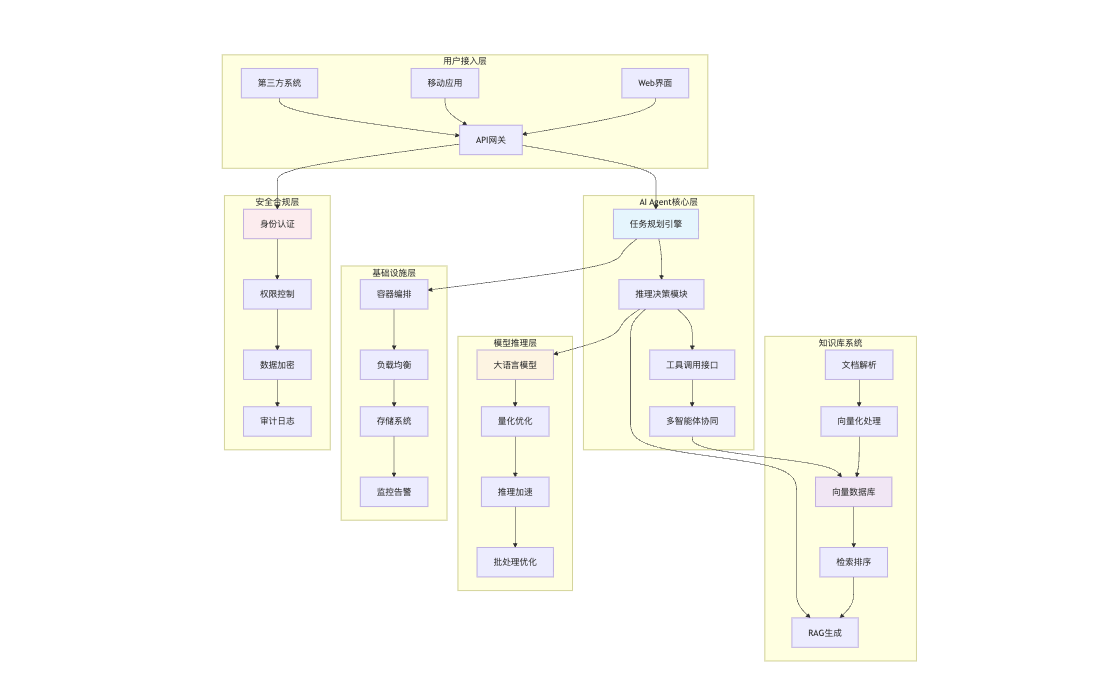

二、技术架构设计:构建企业级本地化Agent系统

2.1 核心架构组件解析

企业级AI Agent本地化部署系统通常包含以下核心组件,形成完整的智能决策与执行闭环:

大模型推理引擎:作为Agent的"大脑",负责理解用户意图、推理决策和生成回复。本地化部署中,推荐使用DeepSeek R1、Qwen等开源模型,通过量化技术将显存需求降至8-16GB。

知识库检索系统(RAG):构建企业专有知识库,支持向量检索、全文检索和混合检索等多种策略。核心包括文档解析、向量化存储、检索排序和内容生成四个环节。

任务规划与执行引擎:将复杂业务目标分解为可执行的子任务序列,支持多智能体协同和工具调用。

安全防护与监控系统:提供身份认证、权限控制、内容审核和行为监控等多层安全保障。

2.2 RAG知识库技术深度解析

检索增强生成(RAG)技术是本地化Agent系统的核心技术之一,能够有效解决大模型"幻觉"问题。

多模态知识处理:现代RAG系统需要支持结构化数据(数据库表格)、非结构化文本(文档、邮件)以及图像、音视频等多种数据源的统一处理。

智能检索策略:

- 向量检索:基于语义相似度的密集检索,适合概念性查询

- 关键词检索:基于BM25等算法的稀疏检索,适合精确匹配

- 混合检索:结合多种检索策略,通过AI路由选择最优方案

检索质量优化:通过Rerank模型对初步检索结果进行重新排序,提升检索精度;采用查询重写、查询扩展等技术增强检索召回率。

2.3 多智能体协同架构

企业级场景往往需要多个专业Agent协同工作,实现复杂业务流程的智能化处理:

| 协同模式 | 适用场景 | 技术特点 | 实现复杂度 |

|---|---|---|---|

| 管道式协同 | 线性业务流程 | 任务串行传递,流程清晰 | 低 |

| 分层式协同 | 复杂决策场景 | 管理层-执行层分离 | 中 |

| 网状协同 | 动态业务场景 | 智能体间自由交互 | 高 |

| 联邦式协同 | 跨域业务整合 | 保持独立性的松耦合协作 | 高 |

三、硬件选型与环境配置:打造高性能本地化部署基础

3.1 硬件配置推荐方案

基于不同业务规模和性能要求,我们提供三套硬件配置方案:

入门级配置(适合小型团队试点):

- CPU:Intel Xeon Gold 6248R 或 AMD EPYC 7543

- 内存:64GB DDR4 ECC

- GPU:NVIDIA RTX 4090 24GB 或 A6000 48GB

- 存储:2TB NVMe SSD + 8TB HDD

- 网络:万兆以太网卡

- 预估成本:15-20万元

企业级配置(适合中大型企业部署):

- CPU:双路Intel Xeon Platinum 8380 或 AMD EPYC 7763

- 内存:256GB DDR4 ECC

- GPU:4x NVIDIA A100 80GB 或 H100 80GB

- 存储:8TB NVMe SSD + 32TB HDD存储阵列

- 网络:双万兆网卡,支持负载均衡

- 预估成本:80-120万元

高性能配置(适合大规模并发场景):

- CPU:四路Intel Xeon Platinum 8480+ 或 AMD EPYC 9754

- 内存:1TB DDR5 ECC

- GPU:8x NVIDIA H100 80GB NVLink集群

- 存储:16TB NVMe SSD + 100TB分布式存储

- 网络:InfiniBand HDR 200Gb/s

- 预估成本:300-500万元

3.2 软件环境搭建指南

操作系统选择:推荐使用Ubuntu 22.04 LTS或CentOS Stream 9,确保长期稳定支持和安全更新。

容器化部署:采用Docker + Kubernetes架构,实现服务的快速部署、弹性扩展和故障恢复。核心组件包括:

- 模型服务容器:基于vLLM或TensorRT-LLM构建高性能推理服务

- 知识库服务容器:集成向量数据库(Milvus/Qdrant)和搜索引擎(Elasticsearch)

- API网关容器:提供统一的接口管理、限流和监控

- 监控服务容器:基于Prometheus + Grafana构建全方位监控体系

依赖环境配置:

# CUDA环境(GPU推理必需)

CUDA_VERSION=12.1

CUDNN_VERSION=8.9

# Python环境

PYTHON_VERSION=3.10

PYTORCH_VERSION=2.1.0

# 核心依赖包

transformers>=4.35.0

vllm>=0.2.5

langchain>=0.1.0

chromadb>=0.4.15

四、模型部署与优化:实现高效推理与成本控制

4.1 模型选择与量化优化

开源模型推荐:

- DeepSeek R1系列:在中文理解和推理能力方面表现优异,支持128K上下文长度

- Qwen2.5系列:阿里云开源的多语言模型,在代码生成和数学推理方面表现突出

- ChatGLM4系列:清华大学开源的对话模型,针对中文场景优化

量化技术应用:

- 4-bit量化:使用QLoRA技术,将显存需求降低75%,适合资源受限环境

- 8-bit量化:平衡性能与资源消耗,推荐用于生产环境

- 动态量化:运行时自适应量化,在精度和效率间找到最佳平衡点

4.2 推理性能优化策略

批处理优化:根据硬件配置和业务需求,合理设置batch size。一般情况下,A100 80GB可支持batch size 32-64,RTX 4090建议batch size 8-16。

KV缓存优化:通过缓存键值对减少重复计算,在多轮对话场景下可提升推理速度50-80%。

模型并行策略:

- 张量并行:将模型层内的计算分布到多个GPU,适合单次推理延迟要求极低的场景

- 流水线并行:将模型层间的计算流水化,提升整体吞吐量

- 数据并行:多个模型副本并行处理不同请求,简单有效的扩展方案

4.3 性能监控与调优

建立完善的性能监控体系,实时跟踪关键指标:

| 监控维度 | 关键指标 | 正常范围 | 告警阈值 |

|---|---|---|---|

| 推理性能 | 首Token延迟 | <500ms | >1000ms |

| 推理性能 | Token生成速度 | >50 tokens/s | <20 tokens/s |

| 资源使用 | GPU利用率 | 60-80% | >90% |

| 资源使用 | 显存使用率 | <85% | >95% |

| 业务指标 | 并发QPS | >100 | <50 |

| 业务指标 | 成功率 | >99% | <95% |

五、知识库构建与管理:打造企业级智能知识体系

5.1 知识库数据源集成

企业知识库通常包含多种异构数据源,需要统一的集成和处理方案:

结构化数据集成:

- 数据库连接:支持MySQL、PostgreSQL、Oracle等主流数据库的直连

- API接口集成:通过RESTful API获取CRM、ERP等业务系统数据

- 文件导入:支持CSV、Excel等格式的批量数据导入

非结构化数据处理:

- 文档解析:支持PDF、Word、PPT、Markdown等格式的智能解析

- 网页爬取:自动抓取企业官网、帮助文档等公开信息

- 邮件归档:处理历史邮件数据,提取业务知识

多模态内容处理:

- 图像识别:提取图表、流程图中的文字和结构信息

- 音视频转录:将会议录音、培训视频转换为文本知识

- 表格理解:智能解析复杂表格结构和数据关系

5.2 向量数据库选型与配置

向量数据库是RAG系统的核心基础设施,不同方案各有优劣:

Milvus:

- 优势:开源免费,支持大规模数据,性能优异

- 适用场景:大型企业,数据量>1000万条

- 配置建议:至少16GB内存,推荐使用SSD存储

Qdrant:

- 优势:Rust开发,内存效率高,API友好

- 适用场景:中小型企业,注重开发效率

- 配置建议:8GB内存即可满足百万级数据

Chroma:

- 优势:轻量化,易于集成,适合快速原型开发

- 适用场景:小型团队,数据量<100万条

- 配置建议:4GB内存,本地文件存储

5.3 知识库质量管理

数据清洗与预处理:

- 去重处理:基于文本相似度和哈希值的智能去重

- 格式标准化:统一文档格式、编码和结构

- 敏感信息脱敏:自动识别和处理个人隐私、商业机密等敏感内容

知识图谱构建:

- 实体识别:自动提取人名、地名、机构名等关键实体

- 关系抽取:识别实体间的语义关系,构建知识网络

- 图谱推理:基于已有知识推断隐含关系,丰富知识体系

质量评估与优化:

- 检索准确率测试:定期评估知识库检索的准确性和完整性

- 用户反馈收集:建立用户评价机制,持续优化知识质量

- 知识更新机制:自动检测过期信息,及时更新知识内容

六、安全合规与运维管理:构建企业级安全防护体系

6.1 五层安全防护架构

企业级AI Agent本地化部署必须建立完善的安全防护体系,特别是在金融、医疗、政务等高敏感行业:

应用层安全:

- 身份认证:支持LDAP、OAuth2.0、SAML等企业级认证协议

- 权限控制:基于RBAC模型的细粒度权限管理

- API安全:接口加密、签名验证、频率限制等防护措施

数据层安全:

- 数据加密:采用AES-256加密算法保护静态数据

- 传输加密:全链路HTTPS/TLS 1.3加密传输

- 访问审计:完整记录数据访问日志,支持合规审计

网络层安全:

- 网络隔离:通过VLAN、VPN等技术实现网络分段

- 防火墙配置:精细化端口和协议控制

- 入侵检测:部署IDS/IPS系统,实时监控异常行为

系统层安全:

- 操作系统加固:关闭不必要服务,应用安全补丁

- 容器安全:镜像扫描、运行时保护、资源限制

- 密钥管理:使用HSM或软件密钥管理系统保护密钥

物理层安全:

- 机房安全:门禁控制、视频监控、环境监测

- 硬件防护:防篡改、防静电、冗余备份

6.2 合规性要求与实践

根据华为发布的《金融智能体应用协同指南》,企业级AI Agent在设计和部署时需要满足以下合规要求:

数据隐私保护:

- 符合GDPR、《个人信息保护法》等法规要求

- 实施数据最小化原则,仅收集必要信息

- 提供用户数据删除和修改权限

模型可解释性:

- 提供决策过程的可追溯性和可解释性

- 建立模型行为的监控和审计机制

- 支持决策结果的人工复核和纠正

审计日志:

- 完整记录所有操作行为,包括用户访问、数据修改、模型推理等

- 日志数据加密存储,防止篡改

- 支持日志的长期归档和快速检索

6.3 运维监控与故障处理

全方位监控体系:

- 基础设施监控:CPU、内存、磁盘、网络等资源使用情况

- 应用性能监控:API响应时间、错误率、吞吐量等业务指标

- 业务质量监控:模型准确率、用户满意度、知识库覆盖率等

自动化运维:

- 弹性伸缩:根据负载自动调整服务实例数量

- 故障自愈:自动重启异常服务,切换备用节点

- 配置管理:统一的配置中心,支持热更新

应急响应机制:

- 故障分级:按影响范围和紧急程度划分故障等级

- 响应流程:明确的故障处理流程和责任分工

- 恢复预案:制定详细的灾难恢复和业务连续性计划

七、成本分析与ROI评估:量化本地化部署价值

7.1 总体拥有成本(TCO)分析

基于实际部署经验和市场调研数据,我们对本地化部署的成本构成进行详细分析:

初期投资成本:

- 硬件设备:占总成本的50-60%,包括服务器、GPU、存储设备等

- 软件许可:占总成本的15-20%,包括操作系统、数据库、监控软件等

- 部署实施:占总成本的10-15%,包括系统集成、数据迁移、人员培训等

持续运营成本:

- 人力成本:占年度成本的40-50%,包括运维、开发、安全等人员

- 电力与机房:占年度成本的20-25%,包括用电、制冷、网络等费用

- 维护升级:占年度成本的15-20%,包括硬件维护、软件升级等

成本优化策略:

- 分阶段部署:先小规模试点,验证效果后再扩大规模

- 混合云架构:核心业务本地化,辅助功能使用云服务

- 开源技术栈:优先选择成熟的开源解决方案,降低许可成本

7.2 与云服务的成本对比

根据市场调研数据,对于不同规模的企业应用,本地化部署与云服务在成本方面的对比如下:

| 日均调用量 | 云服务年成本 | 本地化3年TCO | 成本优势 | 回本周期 |

|---|---|---|---|---|

| 10万次 | 50万元 | 200万元 | 云服务优势 | - |

| 50万次 | 200万元 | 350万元 | 持平 | 30个月 |

| 100万次 | 400万元 | 500万元 | 本地化优势20% | 24个月 |

| 500万次 | 1800万元 | 1200万元 | 本地化优势33% | 18个月 |

| 1000万次 | 3500万元 | 2000万元 | 本地化优势43% | 15个月 |

7.3 业务价值与ROI计算

直接经济效益:

- 人力成本节约:AI Agent可替代部分人工客服、数据分析等工作,年节省人力成本100-500万元

- 效率提升收益:业务流程自动化带来的效率提升,预计年增收200-1000万元

- 决策质量改善:基于知识库的智能决策支持,降低决策失误成本

间接价值收益:

- 数据安全价值:避免数据泄露风险,保护企业商业机密

- 技术自主可控:减少对外部服务商的依赖,提升技术自主性

- 创新能力提升:为企业数字化转型提供强大的技术支撑

八、实施路径与最佳实践:从规划到上线的完整方案

图2:AI Agent本地化部署技术架构图

8.1 分阶段实施策略

成功的AI Agent本地化部署需要系统性的规划和分阶段实施:

第一阶段:需求调研与方案设计(1-2个月)

- 业务需求分析:明确Agent要解决的具体业务问题

- 技术架构设计:选择合适的技术栈和部署方案

- 资源容量规划:评估硬件、软件和人力资源需求

- 风险评估与预案:识别潜在风险并制定应对措施

第二阶段:基础环境搭建(2-3个月)

- 硬件采购与安装:服务器、网络设备的采购和部署

- 软件环境配置:操作系统、容器平台、监控系统的安装配置

- 安全体系建设:防火墙、入侵检测、审计系统的部署

- 基础功能测试:确保基础设施稳定可靠

第三阶段:核心系统开发(3-4个月)

- 模型部署与优化:大语言模型的本地化部署和性能调优

- 知识库构建:企业数据的清洗、向量化和入库

- Agent功能开发:任务规划、工具调用、多轮对话等核心功能

- 系统集成测试:各组件间的集成测试和性能验证

第四阶段:试点运行与优化(2-3个月)

- 小范围试点:选择1-2个业务场景进行试点应用

- 用户培训:对相关人员进行系统使用培训

- 效果评估:收集使用反馈,评估系统效果

- 持续优化:根据反馈不断优化系统功能和性能

第五阶段:全面推广与运营(持续进行)

- 扩大应用范围:逐步推广到更多业务场景

- 建立运营体系:制定运营规范和服务标准

- 持续迭代升级:定期更新模型和功能

- 效果跟踪与评估:建立长期的效果评估机制

8.2 关键成功因素

高层领导支持:AI Agent本地化部署是一项系统性工程,需要企业高层的大力支持和资源投入。

跨部门协作:涉及IT、业务、安全、法务等多个部门,需要建立有效的协作机制。

人才队伍建设:培养和引进AI、大数据、云计算等方面的专业人才。

渐进式推进:避免一步到位,采用渐进式的实施策略,降低风险。

持续投入:AI技术发展迅速,需要持续的技术更新和能力提升投入。

8.3 常见问题与解决方案

问题1:模型推理速度慢

- 原因分析:硬件配置不足、模型未优化、批处理设置不当

- 解决方案:升级GPU硬件、应用量化技术、优化批处理参数

问题2:知识库检索准确率低

- 原因分析:数据质量差、向量模型不匹配、检索策略单一

- 解决方案:提升数据质量、选择合适的embedding模型、采用混合检索策略

问题3:系统稳定性不足

- 原因分析:单点故障、资源不足、监控不完善

- 解决方案:建立高可用架构、扩容资源、完善监控告警

问题4:安全合规风险

- 原因分析:安全措施不足、合规要求不明确、审计机制缺失

- 解决方案:建立完善的安全体系、明确合规要求、实施全面审计

九、行业应用案例与效果分析

9.1 金融行业:智能客服与风控系统

某头部银行通过部署本地化AI Agent系统,构建了覆盖客户服务和风险控制的智能化应用:

应用场景:

- 智能客服:7×24小时自动回答客户咨询,处理账户查询、业务办理等常见问题

- 风险评估:基于客户画像和交易数据,实时评估信贷风险

- 合规检查:自动检查业务流程的合规性,识别潜在违规行为

技术实现:

- 模型选择:采用ChatGLM-6B进行4-bit量化,显存占用降至8GB

- 知识库:整合产品手册、政策法规、历史案例等10万+文档

- 安全措施:部署在专用网络环境,采用端到端加密

应用效果:

- 服务效率提升85%:客户问题平均解决时间从5分钟缩短至45秒

- 人力成本节约60%:减少客服人员200人,年节省成本1500万元

- 风控准确率提升30%:风险识别准确率从70%提升至91%

9.2 制造业:智能运维与质量管控

某大型制造企业通过AI Agent本地化部署,实现了生产设备的智能运维和质量管控:

应用场景:

- 设备预测性维护:基于设备运行数据预测故障,提前安排维护

- 质量异常检测:实时分析生产数据,识别质量异常并自动报警

- 工艺优化建议:基于历史数据和专家知识,提供工艺改进建议

技术实现:

- 多模态数据处理:集成传感器数据、图像数据、文本报告等多种数据源

- 知识图谱构建:构建设备-工艺-质量的知识关联网络

- 边缘计算部署:在生产现场部署边缘计算节点,实现实时响应

应用效果:

- 设备可用率提升12%:通过预测性维护,设备计划外停机时间减少60%

- 质量合格率提升8%:产品一次合格率从92%提升至99.2%

- 运维成本降低35%:维护成本年节省800万元

9.3 医疗行业:临床决策支持系统

某三甲医院部署本地化AI Agent,构建临床决策支持和医疗知识管理系统:

应用场景:

- 辅助诊断:基于患者症状和检查结果,提供诊断建议

- 用药指导:根据患者情况推荐合适的用药方案

- 病历质控:自动检查病历记录的完整性和规范性

技术实现:

- 医疗知识库:整合医学教科书、临床指南、药品说明书等权威资料

- 隐私保护:采用联邦学习技术,在不泄露患者隐私的前提下提升模型能力

- 多模态融合:支持文本、图像、检验报告等多种医疗数据

应用效果:

- 诊断准确率提升15%:疑难病例诊断准确率从75%提升至86%

- 医疗效率提升40%:医生平均诊疗时间缩短35%

- 医疗质量改善:病历书写规范性提升90%,医疗纠纷减少25%

十、未来发展趋势与技术展望

10.1 技术发展趋势

推理能力持续提升:2025年推理模型的快速发展,使得几十亿参数的小模型效果已大幅超越当年千亿参数的大模型。这一趋势将持续推动本地化部署的可行性和经济性。

多模态能力全面整合:未来的AI Agent将具备更强的多模态处理能力,能够同时处理文本、图像、音频、视频等多种信息,实现更自然的人机交互。

端侧Agent兴起:通过本地化部署,端侧Agent不仅能提供更快的响应速度,更能大幅提升数据安全性和用户隐私保护,这将成为企业级应用的重要发展方向。

垂直领域深度应用:AI Agent技术将在金融、医疗、制造、教育等垂直领域实现深度应用,形成行业专用的智能体生态系统。

10.2 市场发展预测

根据德勤调查数据,到2025年,25%使用生成式AI的企业将部署AI Agent,这一比例预计在2027年将增长到50%。

市场规模持续扩大:企业级AI Agent市场将保持高速增长,预计2025-2030年复合增长率超过40%。

应用场景不断拓展:从当前的客服、运维等辅助性场景,逐步扩展到核心业务流程的智能化改造。

技术门槛逐步降低:随着开源技术的成熟和工具链的完善,中小企业也能够负担得起AI Agent的本地化部署。

10.3 挑战与机遇并存

技术挑战:

- 模型能力与资源消耗的平衡:如何在有限的硬件资源下实现最佳的模型性能

- 知识更新与一致性:如何保持知识库的实时更新和逻辑一致性

- 多智能体协同复杂度:如何管理和协调大规模多智能体系统

市场机遇:

- 数字化转型加速:企业数字化转型需求为AI Agent提供了广阔的应用空间

- 政策支持力度加大:各国政府对AI技术发展的政策支持不断加强

- 技术生态日趋完善:开源社区和产业生态的快速发展降低了应用门槛

十一、选型指南:如何选择合适的AI Agent平台

11.1 平台选择关键因素

在选择AI Agent本地化部署平台时,企业需要综合考虑以下关键因素:

技术能力评估:

- 模型支持范围:是否支持主流开源大模型,能否灵活切换

- 推理性能:在相同硬件条件下的推理速度和并发能力

- 知识库能力:RAG技术的成熟度和检索精度

- 多智能体协同:是否支持复杂的多Agent协作场景

易用性与开发效率:

- 部署复杂度:从安装到上线的时间和技术门槛

- 开发工具:是否提供可视化开发界面和丰富的API

- 文档与社区:技术文档的完整性和社区支持力度

- 学习成本:团队掌握平台所需的时间和培训成本

企业级特性:

- 安全合规:是否满足行业安全合规要求

- 高可用性:系统的稳定性和故障恢复能力

- 扩展性:能否支持业务规模的快速增长

- 运维管理:监控、日志、告警等运维功能的完善程度

11.2 主流平台对比分析

基于市场调研和技术评估,我们对主要的AI Agent平台进行对比分析:

| 平台特性 | BetterYeah AI | LangChain | AutoGPT | 其他开源方案 |

|---|---|---|---|---|

| 部署难度 | 低,可视化部署 | 中等,需要开发 | 高,需要深度定制 | 高,技术门槛较高 |

| 模型支持 | 100+主流模型 | 支持主流模型 | 主要支持GPT | 取决于具体实现 |

| RAG能力 | 企业级RAG引擎 | 基础RAG功能 | 基础检索能力 | 需要自行开发 |

| 多智能体 | 原生支持 | 需要额外开发 | 有限支持 | 需要自行实现 |

| 安全合规 | 五层安全防护 | 基础安全措施 | 需要额外加固 | 取决于实现质量 |

| 企业支持 | 专业服务团队 | 社区支持 | 社区支持 | 有限支持 |

| 总体评价 | 企业级首选 | 开发者友好 | 适合研究探索 | 适合技术实力强的团队 |

11.3 BetterYeah AI平台优势解析

BetterYeah AI凭借其企业级原生架构和全栈式技术能力,在AI Agent本地化部署领域具有显著优势:

技术领先性:

- 独家VisionRAG引擎:能够精准理解企业内部的合同、报表、设计图纸等混合型数据,让AI的决策真正基于企业的业务事实

- Multi-Agent协同引擎:通过独特的self-planning核心技术,实现AI的自主任务规划能力,支持多Agent的高效协同工作

- 全栈式LLMOps能力:集成了超过100种业界主流大模型,提供从模型评测、精调、监控到切换的全栈式管理能力

部署灵活性:

- 多种部署选项:支持公有云、私有化、混合云等多种部署方式,满足不同企业的安全和合规要求

- 快速部署能力:相比传统方案的数月部署周期,BetterYeah AI可在3-5天内完成基础部署,大幅缩短项目周期

- 零代码配置:业务人员可通过可视化界面进行Agent配置和优化,无需专业技术背景

企业级保障:

- 五层安全防护体系:从应用层到物理层的全方位安全保障,满足金融、政务等高敏感行业要求

- 高并发支持:支持上万QPS的并发处理能力,确保企业级应用的性能要求

- 专业服务支持:提供从规划设计到实施运维的全生命周期专业服务

结语:开启企业AI智能化新时代

AI Agent本地化部署不仅仅是一项技术升级,更是企业数字化转型的重要里程碑。通过构建自主可控的智能体系统,企业能够在保障数据安全的前提下,实现业务流程的深度智能化改造,为未来的竞争优势奠定坚实基础。

随着技术的不断进步和成本的持续下降,AI Agent本地化部署将从少数大型企业的专利,逐步普及到更多中小企业。那些能够抓住这一技术变革机遇的企业,将在激烈的市场竞争中占据先机,实现业务的跨越式发展。

面向未来,我们有理由相信,AI Agent将成为企业数字化转型的核心驱动力,推动各行各业向更加智能、高效、可持续的方向发展。让我们携手迎接这个充满无限可能的AI智能化新时代。